Gemini 3 è ufficiale: tutte le novità del modello più intelligente di Google tra AGI e agenti AI

A quasi due anni dall’introduzione della famiglia Gemini, Google entra in una nuova fase del suo percorso nell’intelligenza artificiale con il debutto di Gemini 3.

Nel corso degli anni, ogni generazione di Gemini ha ampliato le capacità del modello precedente, fino ad arrivare oggi a un punto di svolta con Gemini 3, progettato per combinare tutte le funzioni della piattaforma in un modello più intelligente, più naturale da guidare e soprattutto più capace nel ragionamento avanzato.

Le novità principali riguardano la capacità di Gemini 3 di cogliere sfumature, intenti e indizi sottili nelle richieste dell’utente. Il modello è stato progettato per comprendere meglio il contesto, riducendo la necessità di prompt complessi e interazioni ripetitive e Google sottolinea come, in soli due anni, l’AI sia passata dal semplice riconoscimento di testi e immagini alla comprensione dell’ambiente circostante, con un livello di percezione molto più vicino a quello umano.

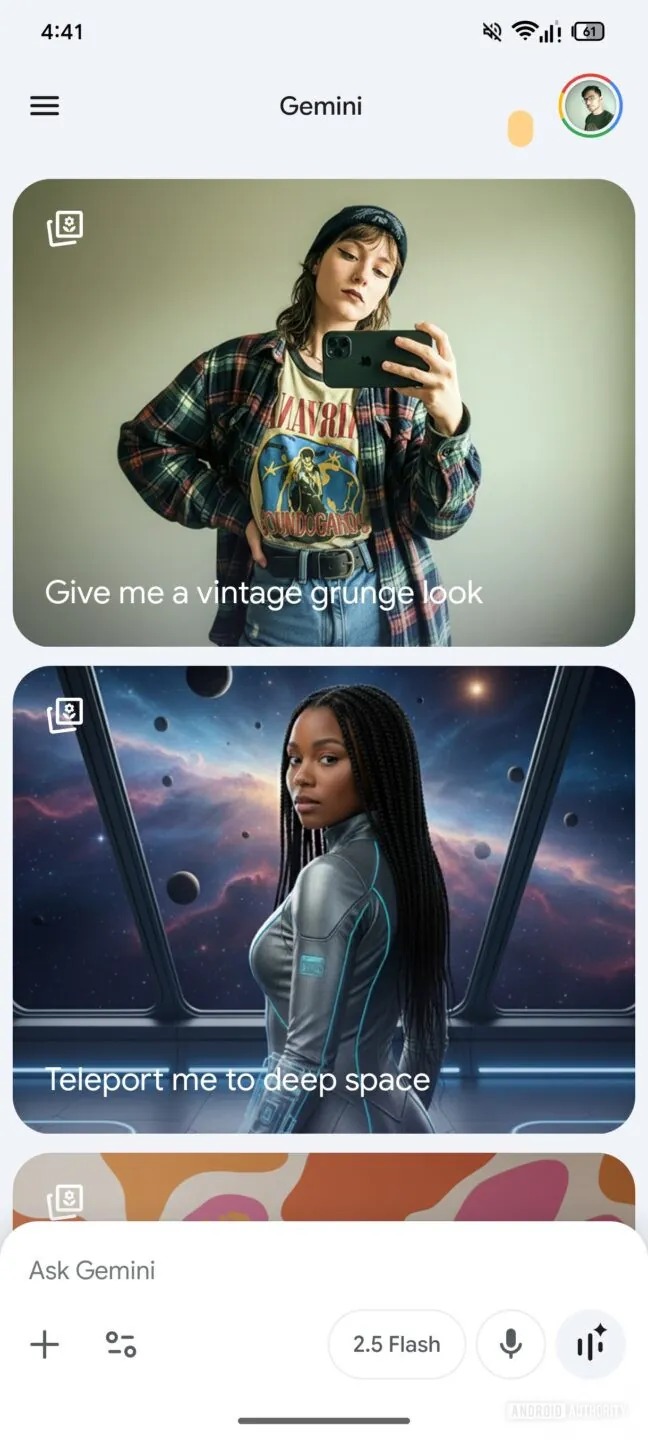

Gemini 3 debutta fin da subito in prodotti come AI Mode nella Ricerca, che introduce risultati dinamici e visualizzazioni più interattive generate al volo, e nell’app Gemini, ora potenziata dal modello di nuova generazione. Parallelamente, sviluppatori e aziende possono iniziare a utilizzarlo in AI Studio, Vertex AI e nella nuova piattaforma Google Antigravity, pensata per il paradigma degli agenti AI.

Le novità tecniche: Pro, Deep Think e i benchmark

Gemini 3 rappresenta un passo significativo verso l’AGI (Artificial General Intelligence) grazie alla sua capacità di ragionare, pianificare e interagire in modo coerente attraverso più modalità: testo, immagini, video, audio e codice.

Sul fronte dei benchmark, Gemini 3 Pro registra risultati superiori rispetto a Gemini 2.5 Pro in ogni categoria. Tra i punteggi più rilevanti troviamo:

-

1501 Elo su LMArena, primo al mondo

-

91,9% in GPQA Diamond

-

23,4% in MathArena Apex, nuovo stato dell’arte

-

81% su MMMU-Pro e 87,6% su Video-MMMU per il ragionamento multimodale

-

72,1% su SimpleQA Verified, con un miglioramento sostanziale nell’accuratezza dei fatti

Le risposte risultano più concise, meno ridondanti e più orientate a un ragionamento autentico, un approccio che Google descrive come la volontà di dire ciò che serve sapere, non ciò che l’utente vuole sentirsi dire.

Accanto al modello principale, Google introduce anche Gemini 3 Deep Think, una modalità progettata per spingere ulteriormente il ragionamento complesso. Nei test interni supera perfino Gemini 3 Pro, con risultati come:

-

41% in Humanity’s Last Exam

-

93,8% in GPQA Diamond

-

45,1% in ARC-AGI, ad oggi uno dei punteggi più alti mai registrati

Questa modalità, dedicata alle attività più difficili, sarà resa disponibile inizialmente ai tester di sicurezza e successivamente agli abbonati Google AI Ultra.

Un assistente per imparare, creare e programmare

Uno degli aspetti più rilevanti della nuova generazione è la capacità di Gemini 3 di aiutare l’utente a imparare in modo personalizzato. Il modello può sintetizzare informazioni provenienti da fonti diverse, come documenti manoscritti, video didattici o articoli scientifici, trasformandole in flashcard, visualizzazioni, spiegazioni guidate o interi percorsi di studio.

L’integrazione con la Ricerca Google consente ora di generare layout interattivi, simulazioni e contenuti dinamici direttamente dalla query, sfruttando la multimodalità nativa del modello.

Sul fronte dello sviluppo, Gemini 3 si conferma come uno dei modelli più potenti per il vibe coding e la programmazione agentica superando i precedenti record su benchmark come WebDev Arena e SWE-bench Verified e supporta nuovi ambienti di sviluppo come Google Antigravity, una piattaforma che trasforma l’AI da semplice assistente a vero co-sviluppatore.

Gli agenti di Antigravity possono accedere direttamente all’editor, al terminale e al browser, pianificando e realizzando interi flussi software in autonomia, convalidando il codice durante il processo. Il sistema è integrato anche con Gemini 2.5 Computer Use per il controllo del browser e con il modello di editing visivo Nano Banana.

Rispetto ai modelli precedenti, Gemini 3 migliora anche la capacità di pianificare attività complesse in più passaggi. Il modello guida ora workflow di lungo periodo in modo più coerente, come dimostrato dai risultati su Vending-Bench 2, benchmark dedicato alla pianificazione a orizzonte esteso.

Questo permette a Gemini 3 di gestire autonomamente operazioni come la pulizia della casella Gmail, l’organizzazione di itinerari di viaggio o la coordinazione di attività multi-step, sempre con supervisione dell’utente.

Google afferma inoltre che Gemini 3 è il modello più sicuro mai realizzato dall’azienda, grazie a un numero record di valutazioni interne ed esterne. Il modello riduce l’inclinazione a seguire ciecamente richieste rischiose e presenta maggiore resistenza alle tecniche di prompt injection e agli abusi tramite strumenti informatici.

Diverse organizzazioni indipendenti — tra cui Apollo, Vaultis e Dreadnode — hanno condotto test autonomi, mentre enti pubblici come l’AISI britannica hanno partecipato alle verifiche preliminari.

Disponibilità

A partire da oggi, Gemini 3 è disponibile da ora nell’app Gemini, per gli abbonati AI Pro e AI Ultra in AI Mode nella Ricerca, per gli sviluppatori tramite API Gemini, AI Studio, Google Antigravity e Gemini CLI e per le aziende tramite Vertex AI e Gemini Enterprise

La modalità Deep Think, dopo i test di sicurezza, sarà disponibile nelle prossime settimane agli abbonati Ultra.